Installations / Expositions #5

Accès libre et gratuit. Des visites groupées peuvent être organisées sur demande.

Cynergia | Corps, image, forces, interaction

INSTALLATION INTERACTIVE

avec la collaboration technique de Stéphane Bœuf, Nicolas Castagné, Nicolas André et Delphine Passinge

Logiciels MIMESIS et Gravure Dynamique, chaussons interactifs

Cynergia combine en temps réel la danse et l’image animée, en interaction à partir des mouvements du danseur. Le système développé dans le projet Cynergia mobilise la perception kinesthésique d’un sujet et l’invite à prendre conscience de son schéma corporel.

L’idée de Cynergia, grâce à l’utilisation des logiciels de l’ACROE-ICA qui permettent des modélisations physiques du mouvement, est de faire le lien entre les perceptions proprio-kinesthésiques que le danseur a de son propre corps, et des représentations visuelles de ces perceptions. De telles représentations s’étaient avérées impossibles avec les outils de synthèse d’image traditionnels en ce sens que ceux-ci conduisent à des représentations plus figuratives et incluent peu — voire pas du tout — les notions de forces, d’énergie, de proprioception ou de kinesthésie. Il y a quelques années, la rencontre entre Bénédicte Adessi, plasticienne et performeuse, et Annie Luciani a permis d’ouvrir de nouvelles voies de recherche technologique et artistique pour tenter de répondre à la question :

Comment rendre plus intelligibles par le spectateur les mouvements d’un corps dansant, en particulier en y associant la perception et la représentation visuelles ?

Le système développé pour le projet Cynergia est composé de trois éléments : des capteurs de forces placés sous les pieds, des modèles physiques réalisés avec MIMESIS et qui sont contrôlés par ces capteurs de forces, et une trace visuelle, également obtenue par modèle physique, des mouvements générés par ces modèles. Les capteurs captent la pression des pieds en appui sur le sol, et rien d’autre. Le modèle physique réalisé avec MIMESIS est une sorte de corps-métaphore virtuelle en terme de masses et d’interactions du ressenti du danseur. C’est le danseur qui réalise ses propres modèles et, dans Cynergia, Bénédicte Adessi en a réalisé plusieurs. La visualisation par modèle physique fonctionne dans le champ visuel comme un écho sonore au sens où elle renvoie une interprétation par un milieu physique des gestes interprétés par le corps-métaphore virtuelle du ressenti corporel. C’est également le danseur — ici Bénédicte Adessi — qui développe les modèles physiques de visualisation.

Cette situation permet au danseur d’extérioriser son schéma corporel, c’est à dire ce qui se passe à l’intérieur de son corps, dans la mobilisation maîtrisée et mémorisable des schémas sensori-moteurs qu’il met en œuvre dans l’exercice du mouvement dansé. Il permet à quiconque qui jouerait des chaussons interactifs face à l’écho visuel de cette émission de forces, de prendre conscience de son schéma corporel. Celui-ci met l’accent sur les appuis plutôt que sur les déplacements corporels : comment appuyer ou alléger sans déplacement visible, ou si peu, comment transférer son poids sans presque bouger ou si peu, etc. Il s’agit donc plus d’intensité que d’extensivité.

With the technical collaboration of Stéphane Boeuf, Nicolas Castagné, Nicolas André and Delphine Passinge

MIMESIS software and Dynamic Engraving, interactive slippers

Cynergia combines dance and the interactive computer animation in real time. The Cynergia framework focuses on the kinesthetic perception inviting the people to be aware of his body patterns.

The aim of Cynergia is to implement a sensitive relationship between the proprio-kinesthetic perceptions that the dancer has of his own body, and visual computer – generated representations. Such representations do not fall easily within the framework of computer image synthesis that is more morphologically realistic and not sufficiently focuses on the notions of forces, energy, proprioception or kinesthesia. A few years ago, the meeting between Benedicte Adessi, a visual artist and performer, and Annie Luciani opened up new ways of technological and artistic research in an attempt to answer to the question:

How can the movements of a dancing body be made more intelligible by the viewer, especially by associating body perception and adequate visual representation?

The system developed for Cynergia is composed of three elements: force sensors placed under the feet, physical models designed with MIMESIS that are controlled by these force sensors, and a visual trace of movements generated by these models also obtained by physical model. Sensors acquire foot pressure on the ground. The physical model made with MIMESIS plays as a virtual body-metaphor in terms of masses and interactions of the dancer’s feelings. The dancer creates his own models. Benedict Adessi made several. It is also the dancer — here Benedicte Adessi — who develops the physical models of visualization.

By this way, the dancer is able to externalize his inner body representation, that is to say what it happens inside his body. It allows anyone who plays interactive slippers in front of the visual echo showing the forces, to become aware of his body pattern. It focuses on forces and energy rather than spatial body movements: how to press, how to transfer weight without apparent motions, etc. So it’s more about intensity than spatiality.

L’espace de Cuneo : Elettronica Portativa

(Portative Electronics) 2010-2019

J’ai toujours envié mes amis musiciens qui, en arrivant au concert, ouvrent le coffret de leur instrument, accordent celui-ci et commencent à jouer : ce n’est vraiment pas comme cela avec la musique électronique.

Elettronica portativa est une idée que j’ai développée tout au long de mon expérience de musicien (en tant que compositeur et organisateur de concerts) inspiré par l’orgue portable fréquemment utilisé à partir du XIIIe siècle.

La relation entre l’orgue portable et la grande église (ou le grand théâtre) est la même que celle entre mon Elettronica Portativa et l’électronique « grande » standard ; avec toutes les limitations et les avantages – facilement prévisibles – dans les deux cas. Une autre manière de voir cela pourrait être celle de l’électronique acoustique : au lieu de monter le niveau sonore des instruments acoustiques jusqu’à celui obtenu par amplification électronique, je choisis au contraire de ramener le niveau sonore de l’électronique à celui des instruments acoustiques (qui ne sont pas, bien sûr, amplifiés, et restent en quelque sorte vraiment « débranchés »).

Deux traits principaux sont en œuvre dans le développement de ce système prototype : d’une part le désir – qui accompagne presque toutes mes compositions électroniques depuis le début des années 1990, avec le fait que la localisation du son coïncide avec celle de l’instrument qui génère les vibrations, et mon expérience avec GENESIS et la synthèse pour les modèles physiques.

Elettronica Portativa sera présentée par l’artiste dans le but de montrer et de discuter des caractéristiques, des possibilités, des limites et du comportement pratique du système et de déclencher des développements et des collaborations futurs. Dans ce contexte, une première composition pour violoncelle baroque et sons GENESIS pourra être expérimentée

I have always envied my musician friends who, on arriving at the concert, open the case, tune their instrument and start playing: not so for electroni music.

Elettronica portativa is a concept I have developed all along my musician experience (as composer and concert organizer) inspired by Organo Portativo, a portable organ frequently used from XIII century.

The relationship between the portable organ and the large church (or theatre) is similar – that between my Elettronica Portativa and the standard “large” electronics; with all the limitations and advantages – easily predictable – in both cases. Another definition could be that of Acoustic Electronics: instead of boosting the sound level of acoustic instruments to the level of electronic amplification, I choose to decrease the level of electronics to that of acoustic instruments (which are not, of course, amplified, but remain truly unplugged).

Two main threads converge in developing this prototype system: the yearning – which has companied almost all of my electronic compositions since the early 1990s – that the origin of sound should coincide with the locus of the instrument that generates the vibrations, and my experience with GENESIS and the synthesis for physical models.

Elettronica Portativa should be presented by the artist with the aim to show and discuss features, possibilities, limits and practical behaviour of the system and trigger future developments and collaborations. In this contest a première of a composition for Baroque Cello and GENESIS sounds should be scheduled.

L’espace de Cuneo : The Extended Guitar

Transducteurs, tambours, ressorts et plaques vibrantes. 2018-2019

Nous présentons un instrument de musique hybride développé par Davide Ficco : une guitare classique qui, équipée de micros hexaphoniques et stéréophoniques piézoélectriques, contrôle deux lignes d’amplification stéréo distinctes : la première qui, au moyen de transducteurs vibrants – excite deux longs ressorts, chacun relié à un daf persan (tambour plat et large); la deuxième qui, également au moyen d’une amplification stéréophonique, excite deux transducteurs vibrants.

Cette configuration permet de générer des sons qui se propagent simultanément au son naturel de l’instrument : les deux dafs produisant un retard naturel par rapport à l’émission de la guitare et les plaques circulaires transmettant des sons qu’un également être traité électroniquement (comme Marco Barberis a expérimenté), avec la caractéristique spécifique de diffuser le son, non pas comme une source ponctuelle, mais de manière étendue, en particulier comme un dipôle, enveloppant l’interprète au centre des dispositifs. Il enrichit cet instrument, que je définis alors comme une guitare augmentée.

La guitare augmentée sera présentée par l’artiste dans le but de montrer et de discuter des caractéristiques, des possibilités, des limites et du comportement pratique de l’instrument et de stimuler des développements et des collaborations futurs. Dans ce contexte, une première d’une composition de Davide Ficco pourra être programmée.

Transducers, drums, springs and vibrating panels. 2018-2019

We will present a hybrid musical instrument developed by Davide Ficco: a classical guitar that, equipped with piezoelectric hexaphonic and stereophonic microphones, controls two distinct stereo amplification lines: the first which – by means of vibrating transducers – solicits two long springs, each connected to a Persian daf (flat and wide drum); the second line which, also by means of a stereophonic amplification, drives two vibrating transducers.

The described configuration allows to generate sounds that spread simultaneously with respect to the natural sound of the instrument: the two dafs producing a natural delay with respect to the emission of the guitar and the circular panels conveying sounds that an also be processed electronically (as Marco Barberis experimentally did), with the specific characteristic of spreading the sound as a not point-like sour e, but extended and as a dipole, enveloping the performer in the center of the devices.It enriches this instrument, which I define as extended guitar.

Extended Guitar should be presented by the artist with the aim to show and discuss features, possibilities, limits and practical behaviour of the instrument and trigger future developments and collaborations. In this context a première of a composition of Davide Ficco should be scheduled.

L’espace de Cuneo : TOTEM

Fer, gong, subwoofer, circuits électroniques. 2018-2019

TOTEM est une installation sonore d’Alessandro Sciaraffa (1976), artiste sonore travaillant à Turin. Dans TOTEM, un grand tam-tam métallique (d’environ 1 mètre de diamètre) suspendu à une structure métallique vibre, déclenché par des fréquences sinusoïdales émises par un subwoofer placé dans son axe à quelques centimètres de distance. Les fréquences ont été choisies à partir de l’analyse acoustique des résonances du tam-tam et de l’écoute dans différents environnements.

Ces fréquences de déclenchement peuvent être modifiées en direct grâce à un contrôleur électronique portable disposant de quelques boutons. En approchant, en brossant, en touchant le tam-tam – avec les mains ou avec des coupelles en métal – aux nœuds de se modes sensibles, n’importe qui peut en jouer, en modifiant les fréquences harmoniques, en créant des résonances différentes dépendantes aussi de l’environnement et la présence physique d’autres personnes ou d’autres objets.

TOTEM sera être présenté par l’artiste dans le but de montrer et de discuter des caractéristiques, des possibilités, des limites et du comportement pratique du système et de stimuler des développements et des collaborations futurs.

Iron, gong, subwoofer, electronic circuits. 2018-2019

TOTEM is a sounding installation of Alessandro Sciaraffa (1976), sound artist working in Turin. In TOTEM a large metal tam-tam (about 1 meter diameter) hanging from a metal structure vibrates triggered by the sinusoidal frequencies emitted by a subwoofer placed coaxially a few inches away. The frequencies have been chosen on the basis of the acoustic analysis of the resonances of the tam-tam and listening in different environments.

These trigger frequencies can be modified live through a portable electronic controller with some knobs. By approaching, brushing, touching – with the hands or with some metallic resonant ups – the tam-tam in its sensitive nodes, anyone an play, it, modifying the harmonic frequencies, creating always different resonances determined also by the environment and the physical presence of other persons or things.

TOTEM should be presented by the artist with the aim to show and discuss features, possibilities, limits and practical behaviour of the system and trigger future developments and collaborations.

L’installation sonore Loops in transmission est basée sur un système interactif de trois dispositifs sonores identiques ou d’outils destinés au traitement de signaux sonores et logiques.

Avec le projet Loops in transmission Staš Vrenko poursuit son exploration des processus matériels et logiciels d’enregistrement, de stockage, de traitement et de transmission du son qui était déjà la base de ses œuvres passées Connective (2016) et techniques d’adoption (2017) le projet traite des supports techniques qui sont capables de construire des modalités spécifiques de mesure et d’enregistrement du temps tout en créant des temporalités uniques basées sur la technologie.

With the project Loops in Transmission Staš Vrenko continues his exploration of hardware and software processes of recording, storing, processing and transmitting of sound that was already the basis of his past works Connective (2016) and Adoption Techniques (2017). The project deals with technical media that are capable of constructing specific modalities of measuring and recording time while also creating unique technology-based temporalities. The sound installation Loops in Transmission is based as an interactive system of three identical sound devices or tools intended for processing of sound and logical signals. The foundation of each tool are smartphone applications developed for this specific purpose, extended with a selection of analogue-digital modular electronic circuits. Through a system of (electromagnetic and data) feedbacks in individual devices and through feedback on the level of communication between devices via LAN connection, Loops in transmission resonate and sonify the micro-temporal processes of analogue and digital tech media that are otherwise inaccessible to human perception.

Meet me (T)here

Cette vidéo est comme un quatuor composé des instruments suivants : la chorégraphie, la caméra, le montage et la musique. La vidéo obéit au principe musical du contrepoint. La synchronisation entre l’image et le son dépend de celui qui regarde, le spectateur devenant ainsi un acteur de la création.

MUSIC TABLE – MusiCode

2017, Interactive sound installation, computer, mouse, monitor

Les codes de programmation sont constitués d’une série d’instructions que l’ordinateur traite dans l’ordre séquentiel. Ces instructions peuvent être utilisées pour générer des hauteurs musicales, des timbres sonores, et même des œuvres entières de la musique. Ce code génère également des sons qui montent ou qui descendent ou une sélection aléatoire de hauteurs.

Une échelle musicale pourrait être décrite comme suit :

- Commencez à 40 (c’est-à-dire, E2) avec le temps 0,

- augmenter la hauteur d’un pas [y x x 1], et sauter 0,25 seconde en avant,

- effectuer cette procédure 20 fois – fini.

Les nombres peuvent être changés, ce qui peut avoir par exemple pour effet de changer l’échelle musicale ascendante par un arpège vers le bas.

Les visiteurs de l’installation MusiCode peuvent jouer avec différents fragments de code, et les changer pour créer leurs propres structures sonores. Devenez compositeur de musique informatique !

Programming codes are made up of a series of instructions, which the computer processes in sequential order. These instructions can be used to generate tones, sound designs, and even entire works of music. This code also generates upward and downward movements or a random selection of tones.

A musical scale could be described as follows:

- Start at 40 (that is, E2) with the time 0,

- raise the tone by one step [y = x + 1], and jump 0.25 seconds forward,

- carry out this procedure 20 times – finished.

Now the numbers can be changed or the + can be replaced by a –, changing the upward musical scale into a downward arpeggio.

Visitors to the MusiCode installation can play with different code fragments, changing them to create their own sound structures. Become a composer of computer music!

MUSIC TABLE – CellularAutomataExplorer

2017, Interactive sound installation, computer, monitor, mouse

Idée: Ludger Brümmer

Programmation, Interface-Design: Benjamin Miller

Les automates cellulaires sont des algorithmes qui peuvent décrire les processus dans l’espace bidimensionnel ou tridimensionnel à l’aide de règles relativement simples. Ils ont été développés par divers mathématiciens et scientifiques à partir des années 1940. Dans son jeu de la vie de 1970, le mathématicien John Horton Conway a défini un automate cellulaire à travers lequel il est possible de simuler les processus du développement des populations d’êtres vivants. L’automate bidimensionnel de Conway est effectivement composé de graphiques sur lequel les cellules individuelles sont placées. Dans leur forme de base, ces cellules peuvent exister sous l’une des deux formes : vivantes ou mortes. L’état de chaque cellule est déterminé par les cellules voisines qui l’entourent. Il existe également des conditions de départ, dans lesquelles les cellules sont arbitrairement définies comme vivantes ou mortes. Chacune de ces cellules suit alors les règles suivantes :

- Une cellule morte avec exactement trois cellules voisines vivantes renaîtra dans la prochaine génération.

- Les cellules vivantes avec moins de deux voisins vivants meurent de solitude dans la prochaine génération.

- Une cellule vivante avec deux ou trois voisins vivants reste vivante dans la prochaine génération.

- Les cellules vivantes avec plus de trois voisins vivants meurent de surpeuplement dans la prochaine génération.

Les automates cellulaires peuvent être utilisés à la fois pour générer des processus visuels et des évolutions sonores. Avec le CellularAutomataExplorer, les visiteurs peuvent modifier les règles des automates cellulaires, déclenchant des processus de composition.

Cellular automata are algorithms that can describe processes in the two- or three-dimensional space through relatively simple rules. They were developed by various mathematicians and scientists beginning in the 1940s. In his 1970 Game of Life, mathematician John Horton Conway defined a cellular automaton through which it is possible to simulate the processes of the development of populations of living beings. Conway’s two-dimensional automaton is effectively comprised of graph paper on which individual cells are placed. In their basic form, these cells can exist in one of two forms: living or dead. The state of each cell is determined by the neighboring cells that surround it. There are also starting conditions, under which cells arbitrarily are defined as living or dead. Each of these cells then faces the following rules:

- A dead cell with exactly three living neighboring cells will be reborn in the next generation.

- Living cells with fewer than two living neighbors die of loneliness in the next generation.

- A living cell with two or three living neighbors remains alive in the next generation.

- Living cells with more than three living neighbors die of overcrowding in the next generation.

Cellular automata can be used both for visual processes and for the development of sounds. With the CellularAutomataExplorer, visitors can alter the rules of cellular automata, triggering compositional processes.

MUSIC TABLE – algoRhythm Machine

2017, Interactive sound installation, computer, monitor, mouse, headphones

L’installation algoRhythm Machine est une sorte d’ordinateur à tambour à travers lequel les rythmes peuvent être générés algorithmiquement ou transformés. Certains de ces algorithmes ont été utilisés dans la musique pendant des siècles, y compris les « crabizans », pour lesquels une section est jouée à l’envers, en référence à la marche du crabe. D’autres algorithmes, tels que les différents algorithmes basés sur le hasard, ont été largement utilisés au XXe siècle.

AlgoRhythm Machine est polyphonique, de sorte que les modèles peuvent être superposés de manière intéressante. Les visiteurs peuvent explorer les paramètres qui mènent à des expériences d’écoute saisissantes.

The installation algoRhythm Machine is a sort of drum computer through which rhythms can be algorithmically generated or varied. Some of the algorithms that are utilized have been used in music for centuries, including the cancrizans, for which one section is played backwards, creating a sort of crabwalk. Other algorithms, such as the various algorithms based on randomness, were first used broadly in the twentieth century.

algoRhythm Machine is inspired by the installations Pattern Machine and Random Machine from 2004, both are also being shown at the Open Codes exhibition. The same algorithms that generate melodies in those installations are used here to generate rhythms. Visitors can pursue the fascinating question of whether the algorithms are equally well suited for both uses.

Unlike with Pattern Machine and Random Machine, no variation in the pitch is possible with algoRhythm Machine. Instead, algoRhythm Machine is polyphonic, such that patterns can be layered in interesting ways. Visitors can explore what settings lead to interesting listening experiences.

Les installations «Guido’s code» #A et #B se réfèrent à ce qui est probablement le plus ancien algorithme musical de l’histoire européenne, formulé il y a presque exactement mille ans par le moine bénédictin Guido d’Arezzo dans sa célèbre œuvre Micrologus de disciplina artis musicae.

Dans l’installation Guido’s Code #B, les visiteurs peuvent découvrir par eux-mêmes comment fonctionne l’algorithme de Guido of Arezzo. Ils entrent un texte dans l’ordinateur, qui est converti en une mélodie selon les règles de Guido d’Arezzo, puis lit en arrière. L’algorithme offre à l’utilisateur certaines libertés et certains choix. Ce qui pousse les visiteurs à former leur propre jugement quant à savoir si la mélodie est un résultat réussi. Cette exploration de la mélodie a été un aspect important pour Guido d’Arezzo, qui voulait fournir aux lecteurs de son livre un outil qui leur permettrait d’apprendre à composer.

En plus de l’algorithme utilisé ici, Guido d’Arezzo a introduit un certain nombre d’innovations révolutionnaires pour la pratique de la musique, comme la clef. Ses innovations visaient à rendre cette connaissance, qui était précédemment exclusivement réservée aux moines, accessible à un plus large éventail de personnes. En ce sens, Guido d’Arezzo a été l’un des premiers pionniers de la culture « open source » et « open access » d’aujourd’hui.

The installations Guido’s Code #A and #B refer to what is probably the oldest music algorithm in European history, formulated almost exactly a thousand years ago by the Benedictine monk Guido of Arezzo in his famous work Micrologus de disciplina artis musicae.

In the installation Guido’s Code #B, visitors can experience for themselves how Guido of Arezzo’s algorithm works. They enter a text into the computer, which is converted into a melody according to Guido of Arezzo’s rules and then played back. The algorithm allows the user certain freedoms and choices. This encourages the visitors to form their own assessment as to whether the melody is a successful outcome. This exploration of the melody was an important aspect for Guido of Arezzo, who wanted to provide the readers of his book with a tool that enabled them to learn how to compose themselves.

In addition to the algorithm used here, Guido of Arezzo introduced a number of groundbreaking innovations to the practice of music, such as the clef. His innovations were aimed at making this exclusive knowledge, restricted to monks, accessible to a wider range of people. In this sense, Guido of Arezzo was an early pioneer of today’s “open source” and “open access” movements.

Sculptures musicales interactives

« les éclatements, fractures, déchirements, fissures … et autres métamorphoses visuelles dynamiques »

Un étudiant en Art-Science-Technologie

Présente sa thèse avec des mots gentils

Une des thématiques de recherche artistique de l’ACROE, en coopération avec le laboratoire ICA, concerne l’art du mouvement visuel, mené sous la direction d’Annie Luciani. Elle fonde le principe que le mouvement visuel en lui-même est objet d’art et que, au-delà du cinéma, sa technologie reste à développer.

Nous en avons déjà l’intuition dans la mesure où il possède déjà un vocabulaire ; indépendant de toute forme visuelle, auditive, ou tactile. Il s’exprime par des verbes comme frémir, palpiter, … des substantifs tels que les balancer, les vibrer … Il peut s’exprimer également via des adjectifs, adverbes ou groupes nominaux qualificatifs : accéléré, doux (un amorçage doux), vif (un décollement vif), lentement, se poser avec légèreté … Le mouvement, c’est-à dire la dynamique, ou mieux encore l’expression de la dynamique, de la manière de changer, d’une manière d’être qui est le changement dans ses qualités, existe donc bien, pour lui-même.

L’ACROE a donc développé une technologie logicielle pour créer et manipuler ce type d’objet artistique. Comme pour le son et la musique, elle se fonde sur la modélisation et la simulation physique, puisque que la physique est la science du mouvement, et a fait l’objet de nombreuses thèses et créations artistiques.

Mais qu’en est-il des transformations dans les dynamiques telles que celles qui adviennent quand quelque chose se rompt, éclate, se déchire ou s’effiloche ?

Dans sa thèse soutenue le 27 mai 2014, Saman Kalantari a étudié les déchirements.

Jérémy Riffet élargit le propos et trouve des méthodes générales pour modéliser et simuler toute sorte de transformations animées.

Computer animation

« bursts, fractures, tears, cracks … and other dynamic visual metamorphoses »

A student in Art-Science-Technology

explain to you his doctoral thesis, kindly

One of a ACROE’s artistic research topics, in cooperation with the ICA laboratory, is related to the art of visual movement, led by Annie Luciani. It rises the principle that the visual movement itself is an subject of art and that, beyond cinema, a specific technology has to be developed.

We already have the intuition to the extent that it already has its own vocabulary. It expressed in verbs such as shuddering, throbbing, … nouns such as swinging, vibrating… It can also be expressed via adjectives, adverbs or qualifying nominal groups: accelerated, soft (a soft priming), lively (a lively detachment), slowly, land with lightness … Movement – that is, the dynamics, or more, the expression of dynamics, of the way of change, of a way of being that is the change in its qualities – therefore exists well, for itself.

Thus, ACROE has developed software technology to create and manipulate this type of artistic object. As for sound and music, it is based on physical modeling and simulation, since physics is the science of movement.These topics founded several scientific theses and artistic creations.

But what about when transformations in dynamics occurred, such as those that happen when something breaks, bursts, tears or frays?

In a first doctoral study, Saman Kalantari, in his thesis defended on May 27, 2014, studied soft tears.

Jérémy Riffet broadens this topic and proposes general methods to model and simulate all kinds of animated transformations.

Sinusoïde

Sinusoid est une étude sur l’empathie.

Cette installation concerne le geste simple.

Une sinusoïde et ses conséquences.

C’est aussi à propos de l’impact de notre présence sur l’environnement.

C’est une pièce à observer calmement pendant que votre présence influence la sinusoïde qui génère le moment.

Veuillez considérer les itérations (le processus de répétition d’une ou plusieurs actions) comme une question d’intérêt en soi.

Arrêtez-vous et observez les phénomènes de vague, soigneusement.

Sinusoid is study on empathy.

This instalation is about simple gesture.

One sinusoid and her consequences.

Its also about the impact our presence on the surrounding enviourment.

Is a piece to observe calmly as the nuance of your presence influence the sinusoid that generates the moment

Please regard iterations (the process of repeating one or more actions) as matter of interest in itself.

Please stop and observe wave phenomena, carefully.

Through the Looking Sound est une installation qui présente un kaléidoscope virtuel comme un outil de lecture de partition. Le concept de base part de la notation musicale comme moyen de représentation et de visualisation artistique de la composition musicale. Ce projet, encore en expérimentation, étudie le vocabulaire habituel des gestes qui, en stimulant nos sens, façonnent la conscience compositionnelle de l’observateur. C’est un petit peu le même caractère chaotique de la composition qui se matérialise dans l’idée du kaléidoscope et de son utilisation interactive par le spectateur.

On peut dire que ce kaléidoscope manuel permet l’objectivation du processus de composition lui-même. On espère ainsi améliorer la compréhension du processus créatif par un public plus large.

Through the Looking Sound is an installation that introduces an artificial kaleidoscope as a conceptual tool for the reading of the score. Its basic concept is the use of musical notation as a mean of representation and artistic visualisation of music composition. This project in progress investigates the common vocabulary of gestures that trigger our senses in order to shape the compositional consciousness of the observer. The very same aleatoric character of the composition is materialised through the idea of the kaleidoscope and its interactive use by the viewer.

This manual kaleidoscope aims at the objectification of the process of composition itself. Its main objective is to enhance the understanding of the creative process by a wider public.

IDE Scene est un extrait musical d’une pièce chorégrahique utilisant des capteurs de mouvement sans fil portables comme dispositifs d’entrée pour contrôler des sons de synthèse. Il fait partie d’un projet de télédanse dans lequel les danseurs dans différents lieux sont connectés via Internet. La performance est un extrait solo et explore diverses stratégies pour la génération de gestes contrôlés des structures musicales et des textures sonores. Parmi ceux-ci, on peut citer: La lecture de segments gestuels à partir de mouvements de l’interprète pour contrôler différentes couches de son, la création de modèles métriques en opérant sur des cycles superposés de battements pour placer des sons individuels sur ceux-ci, et le contrôle sur la granulation et le filtrage de paramètres dans les échantillons sonores. IDE signifie Izutsu – Daphnis – Echo, se référant aux mythes qui inspirent la pièce, issus respectivement du théâtre Noh et de la littérature hellénique et romaine. L’idée sous-jacente commune est celle de la présence virtuelle d’une personne disparue évoquée par le mouvement et le son dans des états émotionnels intenses de désir.

IDE Scene is a musical excerpt from a dance piece using wearable wireless motion capture sensors as input devices for controlling sound synthesis. It is part of a project in telematic dance which connects dancers in performing in different locations via internet. The present performance is a solo excerpt and explores various strategies for gesture controlled generation of musical structures and sound textures. Among these are: Playback of gestural segments from movements of the performer to control different layers of sound, creation of metric patterns by operating on layered cycles of beats to place individual sounds on these, and control on granulation and filtering parameters in sound samples. IDE stands for Izutsu – Daphnis – Echo, refering to the myths that inspire the piece, stemming from Noh theatre and hellenistic and roman literature respectively. The common underlying idea is that of virtual presence of a missing person evoked through movement and sound in intense emotional states of longing.

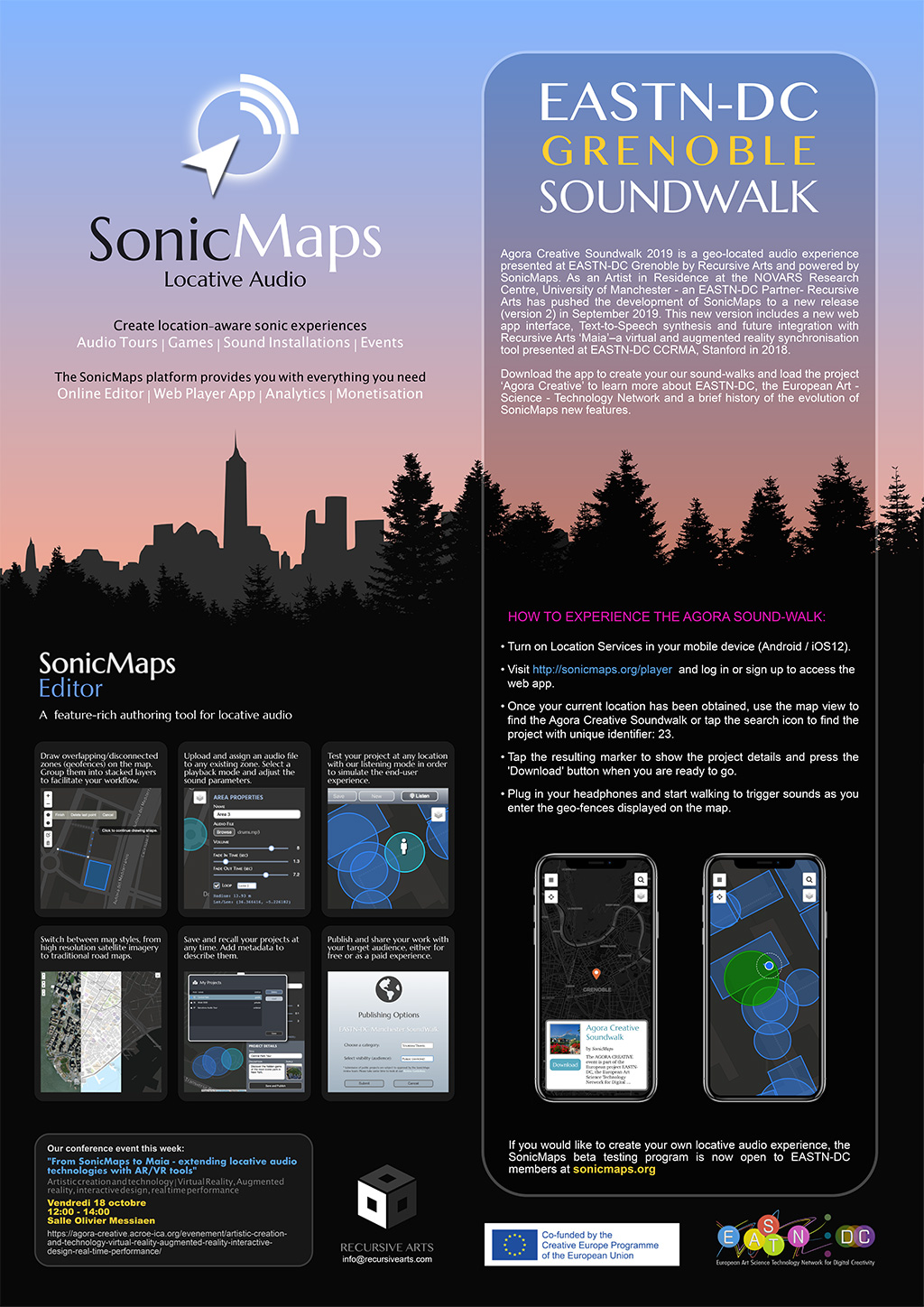

SonicMaps Locative Audio Soundwalk (by Recursive Arts)

Téléchargez l’application et écoutez Agora Creative Project et créez vos propres balades sonores avec la nouvelle fonctionnalité de synthèse vocale.